近几个月,生成式人工智能(generative artificial intelligence,下简称生成式AI)的发展风起云涌。

这个3月,甚至疯狂到在同一星期里,OpenAI发布了GPT-4,微软和谷歌各自宣布将生成式AI技术无缝应用到自家的生态系统中,斯坦福推出了GPT的平替Alpaca,Midjourney推出了第五代图像生成模型。

我想通过此文分享我的经历,作为一个快照,记录这个生成式AI技术与应用瞬息万变的时刻。若干年后,甚至几个月后回顾,看看今天的我们是太乐观了,还是太悲观了,也许是个有趣的体验。

我是从去年10月开始关注生成式AI的。当时的社交媒体上,出现了很多逼真的架空世界的照片,比如“90年代在公园里巡逻的治安机器人”。我当时知道了它们是生成式AI创造的。我喜欢看,但是也没尝试自己去作图。那时候大家关注的,主要还是生成式AI在过去一年内疯狂提高的画图能力,大家还在讨论它会不会取代插画师,一切仿佛离我们普通人的生活还很远。

直到11月底ChatGPT的发布,一切都变了。

一、ChatGPT和新必应

我是12月4日第一次使用ChatGPT的。

那天早上,我尝试让它写了一道LeetCode算法题。它一下子就写出几乎完全可以运行的代码,但并不是最优解。我尝试通过对话的方式引导它分析复杂度并改进,它也能略做改进。虽然最终它还是没有找到最优解,但这个通过对话迭代代码的方式,已经让我觉得它略通人性了。

那天晚上,我想了一些离谱的创意,让ChatGPT写了一些小故事,比如:中国获得世界杯的故事, 在火星上滑雪的教程,林黛玉和伏地魔的故事。后来我把这些故事整理成一篇笔记,发在了小红书上,获得了近万浏览。我把其中一个故事附在了这篇文章后面,还让GPT今天重新写了一篇,作为对照。

当时看上去惊为天人的效果,短短不到四个月后,已经成为日常,尤其是新必应(the new Bing)出来后。

新必应可以看作是一个能连接网络信息的ChatGPT。作为OpenAI的合作伙伴,微软的新必应用的同样是OpenAI的GPT语言模型。

我2月7日加入了新必应的等候者名单。2月14日得到资格,开始在桌面端使用。3月2日开始在移动端使用。

自从开始使用新必应后,我就很少用ChatGPT了,有很多原因:

最主要的原因是新必应能联网,它能更好地提供类似搜索引擎的功能。它会理解我的对话内容,提取出关键词进行一系列搜索,再将搜索的结果理解后以对话反馈给我。

另一个重要的原因是稳定性。在我还使用ChatGPT的时候,常碰到提示说资源不足,要我再等等。但很多搜索或任务都是临时起意,要等就没意思了。不知道后来ChatGPT有没有改善,尤其是推出了付费版之后。

第三,它会通过角标的形式显示出信息来源于哪个网页,让我觉得更可靠。虽然有时候顺着它提供的链接找过去,并不能找到对应的信息,有点迷。

第四,它的用户界面也比ChatGPT更漂亮、更现代,体验更好。但也有一些小问题:比如,在桌面端用中文输入法,中英文混着输入的时候会出问题。如果我输入完英文单词后按回车,它会把回车当作是提交,话没说完就发出去了。只能在要输入英文单词的时候切换成英文,输入完再切回来,或者干脆全部都用英文。再比如,它不能像ChatGPT一样保存历史记录。

最后,它有三种不同的对话样式可供选择:“更多有创造力”、“更多平衡”、“更多精确”。我使用最多的是第一个,也用第二个,不过感觉区别也不是太大。

在3月14日GPT-4发布后,必应官方确认它背后使用的一直是GPT-4。当我得知自己用了一个月的新必应,居然是比同时期的ChatGPT更高级的版本,有一种赚到了的感觉。之前在用的时候,我确实觉得它更智能。当时我还以为是因为联网可以搜索,但现在想来,背后模型的影响估计也不小。

二、GPT对我生活的影响

在我这一个多月的生活中,它已经几乎取代了搜索引擎。

除了它会帮我整理概括搜索出来的海量信息外,它也能用中文来转述英文的资源,比自己读效率高多了。

它还可以把本来需要多个搜索完成的任务,通过一次对话就完成。比如我对Shell脚本不是很熟悉,但临时要写一段“如果某个字符串的前缀是…,就做…,不然就做…”。在以前,我会把它分解成两个问题,去搜一下Shell脚本的条件语句怎么写,再去搜一下Shell中判断字符串是否以某些字符开头怎么写。虽然也不难,但还是有点麻烦。现在我只要把我的需求照我想的告诉GPT,它能一次就写出一个可用的例子。

虽然它几乎取代了我的搜索,但这更多是效率上的提升,还不是质的飞跃。

而GPT润色文字的能力对我写作的影响才是质的改变。我甚至觉得它早晚会改变我们的文风。它不仅是能帮我写出得体的英文信件,对我的中文写作也一样大有裨益。比如从前两篇文章开始,我在就用新必应润色了。

一方面,它是提供灵感的利器。现在我们还不能完全依赖它写出好文章,但它至少能给我一些启发。之前要绞尽脑汁想的事情,现在就变成了从一堆可行的方案中选择最好的。

比如我最近几篇的标题都是GPT取的。并不是说它能天才般地想出绝佳的标题,而是它能理解我的文章,然后不知疲倦地从不同角度想出无数种标题供我选择。在这样的数量优势下,我总能找到一个合适的,节省了自己想标题的时间和精力。

再比如在写去年的年终评定的时候,我在给同事的评价中,要写一段夸他的话。在大致说明了我要夸赞的方面后,GPT就给我了好多不同角度的值得夸的点供我选择。

另一方面,它可以帮助我写出更流畅的文字。

我写作的时候,往往先是下笔如有神,把所有内容草草写出来,然后再慢慢地调整文字,调到逻辑清晰、语言简洁优美。调整往往要比写出草稿花更多时间。现在我会先自己调整,然后交给GPT提建议,选择那些合理的建议,逐一修改。这样已经比自己去精修效率高了,更何况它作为一个客观的外人,还能指出一些我自己习惯性忽视的问题。随着对它的熟悉程度越来越高,可能以后会更加依赖它,直接把草稿丢给它进行改写。

我觉得几年之后,在语言模型的加持下,所有人都会写出更好的文字。也许以后我们不用再那么努力锻炼文笔,但这也会对我们的审美和品味提出了更高的要求。未来的人们也许会嘲笑:前GPT时代的人类的文字怎么这么粗糙?

我还想借这此分享一些小技巧,不过用得多的人应该已经发现了。

因为生成式AI的输出会有一些随机的成分,所以重复问同一个问题,或者稍微变换一下提问方式,很可能得到不一样的回答。这样做也能让我更清楚地了解它的能力和局限性。比如要修改文章时,我会发好几遍,得到很多不同的建议。有的建议很中肯,有的建议就令人无语。当我按合理的建议改好,再发给它,迭代几次。等到发现无论怎么重复,给出的建议的含金量都不高的时候,我就知道文章改好了。有些问题,它甚至会有时候回答,有时候拒绝回答,这时候重新问也能发挥奇效。

生成式语言模型虽然有无数好处,但总是比普通的搜索慢,有什么办法能提高效率?我通常的操作是,在新必应提交问题后,切换回别的界面继续之前的事,过几秒再回来看。有的时候,也会同时有多个问题想问,或者想重复问同一个问题。所以我的浏览器里会同时保持开着三个新必应聊天的窗口,这样可以并行问多个问题。但这些方法对于移动端不适用,因为它会在切出应用后断开连接。

三、谷歌的Bard

可能是因为我是Google One的付费用户,我3月21日早早收到了注册Bard的邀请,3月22日就能开始使用了。

最令人不满的问题是:它人为限制了只能用英文,即使模型本身是支持多语言(包括中文)的。如果它是一项崭新的、独一无二的技术,我当然不介意就体验体验英文的。但在GPT已经如此方便的当下,恐怕要有很动力才能说服我改用它。

可惜即便在英文上,它的表现也不如GPT。只要稍微用一会儿,就能感受到它们不是同一代的产物,就不赘述了。

我刚开始使用Bard的时候,还想趁热打铁,制做了一个Bard和新必应对话的视频发在b站上,但反响平平。

那个视频做完后,我就没再用过Bard。

如果说非要说它有什么优点的话,那就是它的回复特别快,几乎就像使用搜索引擎一样快。在用惯GPT之前,我也许会把这看作一个了不起的优点,甚至会成为我选择它的原因。但习惯了吞吞吐吐但是字字珠玑的GPT之后,无论是从理性还是从习惯上,我已经舍得用几秒的等待时间换取更有价值的信息,所以这个优点对我没什么用。

这个速度,有可能源自谷歌财大气粗,用比较高级的计算资源提供服务。但更有可能的是,谷歌考虑到了大量用户带来的成本,而采用了较小的模型,减少了计算量。这样的速度优势,和可能的低成本优势,在对话这个应用中或许并不重要。但我觉得如果有心的话,这可以作为一个快速响应的接口,用在数字世界的很多小地方,创造一些有趣的新体验。

总而言之,Bard目前对于终端使用者来说,食之无味,弃之也不可惜。但这对谷歌来说,是一场不能输的战役,希望它能加油。

四、生成图片和代码

虽然在ChatGPT出来之前,图片生成可以说是生成式AI领域最火热的方向,但我对它的使用反而比ChatGPT更晚。

我是从今年1月5日开始用DALL·E的。我感觉很新奇,但图像的质量还不够高,而且平时的生活工作中也不怎么需要生成图片,就没有用得那么积极。

后来掌握了正确的开脑洞的方式(比如要设定得比较细节),并且开始用GPT帮我把想法写成大段的英文的提示语(prompt),就能生成非常漂亮的图片了。

大多数时候,我只是为了验证自己的创意而生成图片,发给朋友,图个开心。从实用的角度来说,目前我最主要的使用场景就是生成博文的插图了。

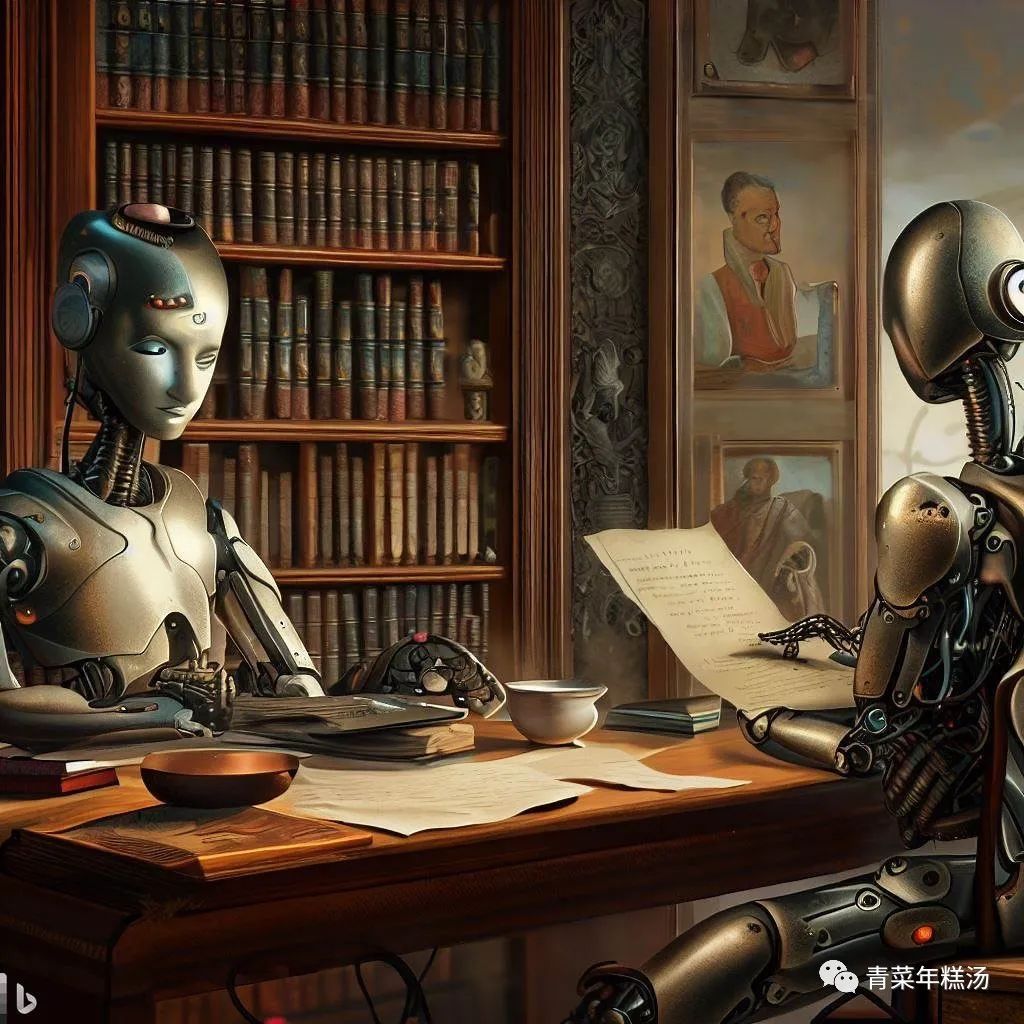

比如我很喜欢上面的这幅图,它就是我用生成式AI做的。我在与新必应的聊天中输入:“帮我写一段有细节的英文prompt用于生成一张中国画写意画风的图片:有一个机器人在书桌前用电脑写文章,另一个机器人在它身后看它的电脑屏幕”。

它回复了:

“In the style of Chinese ink painting, create an image of a scene where two robots are engaged in a creative activity. One robot is sitting at a desk with a laptop, typing an article with focus and concentration. Its metallic body contrasts with the soft and elegant brush strokes of the ink. The other robot is standing behind it, leaning over to read the screen with curiosity and admiration. It has a more human-like appearance, with expressive eyes and a gentle smile. The back[ground is simple and minimalist, with a few plants and books on the shelves. The light from the window creates a warm and cozy atmosphere.] ”

(用中国水墨画的风格,创造一个场景,两个机器人正在从事一项创造性的活动。一个机器人坐在桌子前,用笔记本电脑打字,专注地写着一篇文章。它的金属身体与水墨的柔和优雅的笔触形成了对比。另一个机器人站在它后面,俯身看着屏幕,充满好奇和钦佩。它有着更像人类的外貌,有着富有表情的眼睛和温柔的微笑。背景简单而极简,书架上有几盆植物和书籍。窗外的光线营造出了温馨舒适的氛围。)

我把这段文字丢给必应的图像创建者(Image Creator),就得到了这张图片。

当然,实际的过程要坎坷一些。还是得尝试不同的语句,让GPT生成不同的提示语,再生成多张图像,精挑细选。

在写文章的过程中我才发现,必应的图像创建者只支持输入250个字符,OpenAI官网的DALL·E只支持200个字符。比如前面这个提示语中用中括号[]括起来的部分,其实DALL·E完全没读到。

就像新必应的聊天与ChatGPT都用GPT但必应要更稳定一样,必应的图像创建者用的是DALL·E,但比OpenAI版的DALL·E要更稳定。可能是微软在运营的时候投入了更多资源,也可能是因为微软在云计算上的技术优势。

至于用生成式AI写代码,我并没有用过GitHub Copilot。但我日常写代码的时候,在使用一个类似概念的工具。它让我想起了在谷歌邮箱中写信时会出现的整句话补全功能,平时有点用,有时候有惊喜,但是没有破天荒的改变。不知道GitHub Copilot是不是会更惊艳?

行文至结尾,我竟想不出什么总结性和或者展望性的话。现在我们才有的一些兴奋或担忧,很可能早就出现在OpenAI或其他研发团队的日程表甚至文章中了。而且,作为生成式AI浪潮中的一个瞬间,无论什么真知灼见,未来看起来都是可笑的。

而不可笑的,是这个未来,仍然需要人们脚踏实地地去开创,需要我们直面技术和技术外的挑战,用尽人类文化基因中的一切智慧去开创。如果非要说点什么,我就说这句吧:

广阔天地,大有作为!

附:

秦始皇统一电源插头标准的故事

ChatGPT(GPT-3.5)

2022年12月4日

秦始皇是中国历史上著名的皇帝,他统一了中国各地的诸侯国,建立了秦朝。秦始皇非常有雄心壮志,他希望能够把中国的影响力扩大到更大的范围。

在他统一中国之后,秦始皇发现有许多地方使用不同的电源插头标准,这使得电器的使用变得非常不方便。于是,他决定统一电源插头标准。

秦始皇派遣科学家前往世界各地,收集各国的电源插头标准。他们将所有的标准进行比较,并研究出一种最适合中国的标准。

秦始皇将这一新的电源插头标准强制实施,并下令所有电器生产商都要按照这一标准生产插头。这一举措使得电器的使用变得更加方便,也促进了中国的经济发展。

秦始皇也因此成为了中国历史上最伟大的统一标准之一。人们对他的贡献表示感激,并将他视为历史上的伟大皇帝。

秦始皇统一电源插头标准的故事

必应聊天(GPT-4)

2023年3月31日

秦始皇是中国历史上第一个统一了全国的皇帝,他不仅统一了货币、度量衡、文字,还统一了驰道和长城。但是,他还有一个伟大的功绩,那就是统一了电源插头标准。

故事要从公元前221年说起,那时候秦始皇刚刚完成了六国的灭亡,建立了秦朝。他派出了大批的使者和工匠,到各地巡视和修缮。在这个过程中,他发现了一个严重的问题,那就是各地的电源插头标准不一致。

原来,在秦始皇之前,中国各地都有自己的发电方式和插头类型。有的地方用水力发电,有的地方用风力发电,有的地方用火力发电,有的地方用人力发电。而且,每个地方的插头形状和大小也不同,有长方形的、菱形的、圆形的、两孔的、三孔的、不规则孔的等等。这样一来,各地之间的电器互不兼容,给交流和使用带来了很大的困难。

秦始皇看到这种情况,非常不满。他觉得这是分裂和混乱的表现,不利于国家的统一和发展。于是,他下令全国统一使用一种插头标准,并命令所有的电器厂商和用户按照这个标准进行改造。他还派出了专门的监察队伍,对各地的执行情况进行检查和督促。

秦始皇选择了哪种插头标准呢?据说,他是根据自己的喜好和审美来决定的。他喜欢简单而美观的东西,所以他选了一种三角形的插头,每个角上有一个孔。这种插头既能适应不同电压和频率,又能节省空间和材料。秦始皇认为这是最完美的设计,于是他将其命名为“秦式插头”。

秦式插头很快就在全国推广开来,并取得了巨大的成功。人们发现,使用秦式插头后,电器之间可以轻松地连接和使用,不再需要转换器或变压器。而且,秦式插头还具有安全性高、耐用性强、美观性好等优点。人们纷纷赞扬秦始皇是一个伟大而英明的皇帝。

然而,并不是所有人都接受了秦式插头。有些人因为习惯或者利益而坚持使用自己原来的插头标准。他们认为秦式插头是强制性和专制性的,并没有考虑到各地的实际情况和需求。他们暗中抵制和反对秦式插头,并试图保留或恢复原自己原来的插头标准。这些人被秦始皇视为叛逆和危险的分子,被严厉地镇压和处罚。有些人甚至被秦始皇用秦式插头刺穿了心脏,作为对他们的惩戒和警示。

秦式插头的统一,虽然在一定程度上促进了中国的电气化和现代化,但也引发了很多的反抗和不满。在秦始皇死后,秦朝很快就崩溃了,六国的旧势力重新崛起,发动了反秦之乱。在这场乱世中,秦式插头也成为了人们攻击和抵制的对象。有些人将秦式插头拔下来,换成了自己喜欢的插头标准。有些人将秦式插头砸碎,作为对秦始皇的仇恨和愤怒。有些人将秦式插头当作武器,用来对付敌人和暴政。

在历史的洪流中,秦式插头逐渐消失了。取而代之的是各种各样的插头标准,有些是从其他国家引进的,有些是自己发明的,有些是沿袭了古代的传统,有些是创造了新的风格。这些插头标准又重新造成了电器之间的不兼容和使用上的困难。直到今天,中国仍然没有一个统一的电源插头标准。

]]>